是在组内技术分享的演讲稿,也是本人四年AI Coding的一些感受与思考 最近一年的技术专项都围绕着AI Coding展开,也是边感慨边写下了下面的文字。

背景

还记得是2022年的夏天,还是大一的我在苦学《C语言程序设计》,舍友突然冒过来说Github出了个贼牛逼的插件叫Copilot,学生认证之后,只需要输入中文描述我们要实现的功能,然后一路Tab,AI就能像变魔法一样帮我们把代码都写了,别老是惦记钻研C语言里的指针指向啥了!

Copilot自动补全代码

当时GPT-3才刚刚发布,AI的编程能力其实并不强,只能做一些很简单的补全操作,但即便如此,“魔法一样的Copilot”仍然在23年中被超过 100 万开发者激活。

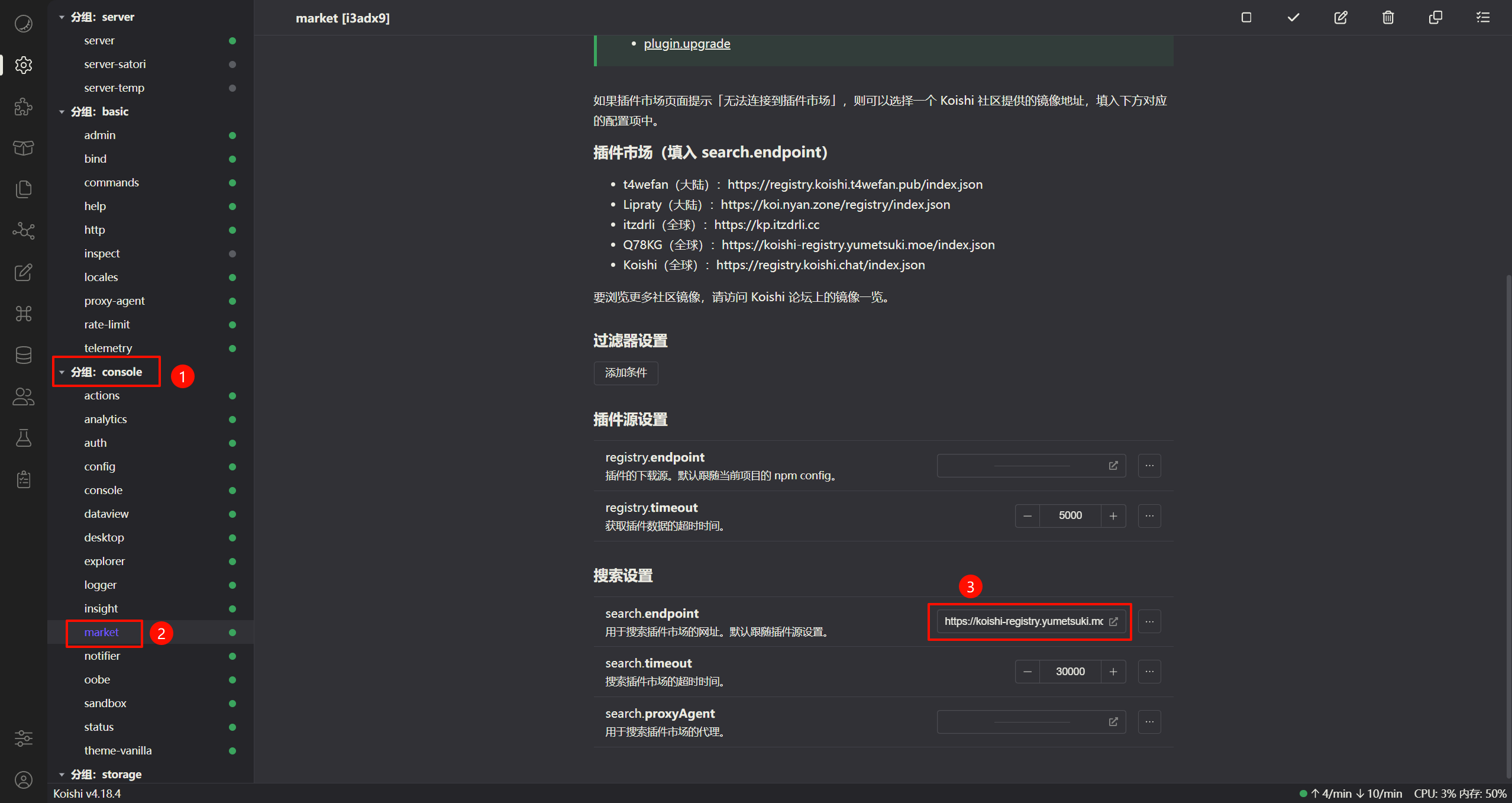

而四年后的今天,AI Coding早就不仅仅时候ide中的代码补全:通过对话式编辑、终端启动应用输指令、Web异步任务派发,前俩天翛然打通Lovelace的内网穿透,在手机上也可以进行编程。任务的大小也从最开始的code片段到文件编写再到现在的系统开发,AI代码生成已经逐渐成为软件工程领域的一个新的方向,影响着工业界、学术界甚至是完全不懂代码的爱好者们。

微软于2020年2月发布的BERTCode被认为是第一个基于Transformer架构的代码生成模型,而在2021年8月发布的基于GPT3微调的CodeX,成为AI代码生成领域的另一个里程碑,该模型于同年八月被应用于Github Copilot产品。2022年末,随着GPT3.5发布,基于通用大语言模型+Agent的代码生成产品开始与针对代码生成任务的专用模型并行发展,各家的AI Coding项目也如雨后春笋般涌现。

产品 | 文档 | 公司 | 发布日期 | 备注 |

| Github | 2021.10.27 | IDE插件,主要聚焦于AI代码补全 | |

| Anysphere | 2023.3.14 | 早期可用版本,IDE工具,支持AI补全、编辑,但不支持对话操作 | |

| https://developer.android.com/studio/gemini/overview?hl=zh-cn | 2023.05.10 | Android Studio 内置对话式编码助手:回答问题/生成代码/修错,强绑定 Android 开发栈。 | |

| JetBrains | 2023.6.26 | 各家厂商的翻版Copilot,提供代码补全、单元自测编写等功能 | |

| 百度 | 2023.10.24 | ||

| 阿里巴巴 | 2023.10.31 | ||

| https://windsurf.com/blog/codeium-live?utm_source=chatgpt.com | GitLab | 2023.11.15 | 在浏览器中通过“聊天 + 外部知识更新”的使用AI进行编程。 |

| Cognition | 2024.3.12 | 端到端AI代码生成能力,覆盖软件生命周全流程 | |

| Github | 2024.4.29 | 深度集成Github,具备代码生成与Debug能力 | |

| 字节跳动 | 2024.6.27 | 偏重于IDE插件,提供Cloud IDE环境,尚不具备端到端代码生成能力 | |

| Saoud Rizwan | 2024.10.9 | 在2.0版本由Claude Dev改名而来,支持读写文件、创建项目、执行终端命令的对话式插件。 | |

| Zed Industries | 2024.8.20 | 在 Zed 编辑器里集成 AI,支持AI对话和编辑 | |

| StackBlitz | 2024.10.22 | 在网页中提供AI 编程环境,根据用户idea快速生成可运行全栈应用 | |

| GitLab | 2024.11.13 | 独立 Agentic IDE :把对话/任务执行(Cascade)和编辑器深度融合 | |

| 字节跳动 | 2024.11.20 | 类似于bolt, AI 驱动的轻应用生成平台,在网页中迅速实现Idea | |

| Anysphere | 2024.12.17 | 引入 Yolo Mode(允许 agent 自动运行终端命令),支持Agent 能看终端内容、在后台跑命令 | |

| 阿里巴巴 | 2024.12 | 由补全/问答升级到 多文件修改 + 工具使用的端到端任务(AI 程序员) | |

| 字节跳动 | 2025.1 | Claude 的 终端/IDE 里的 Agentic coding(可运行命令、改文件、做任务) | |

| 字节跳动 | 2025.1.20 | 异步办公助手,后续迭代升级后,拓展AI Coidng能力,拥有搭建环境、编辑代码、预览网页的功能 | |

| JetBrains | 2025.1.23 | JetBrains内置的coding agent:可委派任务、执行命令、产出可审查的代码变更。 | |

| Monica | 2025.3.6 | 能够自主完成复杂任务的AI助手,与Aime类似 | |

| Anthropic | 2025.5.22 | 伴随claude 4一起被公布,支持在终端里当“coding agent” | |

| 阿里巴巴 | 2025.5.30 | 2.0版本升级为AI 原生 IDE:集成智能体、行间建议、工程感知、工具调用等。 | |

| Anysphere | 2025.6.4 | 引入 Bugbot,支持Background Agent(远程/后台 agent)走向更大范围可用影响力外溢到github社区,优化 MCP 一键安装等 | |

| 字节跳动 | 2025.7.18 | 把“AI 助手”升级成一个以任务为中心的 Coding Agent 工作台:打通终端、编辑器、文档、浏览器、Figma等上下文,由plan到edit完成目标。 | |

| 腾讯 | 2025.9.9 | 腾讯版独立 AI IDE,集成了插件、IDE、CLI三端,类似于Trae + coco | |

| 字节跳动 | 2025.9.9 | 对标 Claude Code / OpenAI Codex / Gemini CLI,在终端中完成任务 |

随着基础模型能力持续增强,AI Coding 的业界焦点正在从“写代码”走向“做软件”。早期以代码补全为代表的能力,主要解决的是编码阶段的局部效率问题;而当模型在自然语言理解、长上下文、工具调用与规划能力上显著提升后,AI 生成的产物不再局限于代码本身,而是逐渐覆盖需求澄清、方案设计、代码注释、单元测试、缺陷定位与修复、代码评审建议、变更说明乃至 PR/Issue 的闭环交付等多类软件工程产物,业界产物的覆盖点也从 LLM4Code扩展为了 LLM4SE(Large Language Model for Software Engineering)。

从产品形态看,最早流行的是 IDE 插件式助手:如 GitHub Copilot、JetBrains AI Assistant 等,它们以“预测下一个 token/下一段代码”为核心,能力主要覆盖编码阶段。随后,随着对话式交互与代码理解能力增强,这类工具逐步叠加了代码解释、仓库问答、重构建议、单测生成、缺陷修复与局部优化等能力,并开始尝试把工作流向“评审—测试—提交”扩展。进一步地,以 Cursor 这类 Agentic IDE 为代表的产品开始把“实现—提交—PR”做成一条更连续的链路:它的 Cloud Agent 能直接从 GitHub 克隆仓库、在独立分支上修改并推送代码,方便交接与评审;结合其 GitHub 集成,还可以围绕 issue/PR 触发 agent 工作流,自动把修改结果沉淀为可审阅的 PR。

在2022到2024的两年中,这些能力更多以“散点插件能力”的形式存在:它们可以分别完成补全、解释、生成测试、修复 bug,却缺少把需求理解、实现路径、验证方式等串成闭环的自主规划与决策能力。于是近一年(2025)开始出现两类更“端到端”的路线:

- “虚拟程序员 / 工作室”式端到端交付:以 agent 智能体为核心,把“理解需求—分解任务—检索项目与知识—生成/修改代码—运行测试”组织成完整链路,目标是让用户用一句话描述意图后,系统像真实程序员一样分析项目、执行计划并交付可用软件。如Bolt、AIPA,融合网页编辑器快速搭建开发环境,交付代码给用户。同时也有Aime、Manus这类全能AI智能体,将编程作为AI能力的延伸,面向非开发者完成代码开发。

在Manus上用一段idea生成炫酷的前端界面

- Agentic IDE / Cli一体化:把补全、对话、检索、重构、运行/调试、生成测试与多文件修改统一在同一编辑器内,由“代理”持续维护任务目标与上下文,尽量减少开发者在工具间切换。典型如 Cursor 与 TRAE,强调在编辑器内由 agent 持续推进实现、修复与迭代,也有Claude Code、coco,利用终端的能力完成编码任务,在编辑器中显现代码diff便于采纳。

与此同时,生态层也在不断变化:端到端 AI Coding 的可组合化正沿着一条“先工具、再上下文、再流程、最后编辑器”的路径落地,而且每一层背后都有明确的推动者。Anthropic 提出MCP并开源,用统一接口把部署、日志、工单、数据库等外部系统能力暴露给 agent,解决“agent 能做什么”的问题;OpenAI 在 Codex 体系中提出skills 概念,把修 bug、补测试、发布等任务固化为可复用的“流程 + 资源 + 脚本”包,方便团队共享并支持多代理分工;Zed 提出 ACP开放协议,类似于LSP协议,旨在标准化 code editors 与 coding agents 的通信,支持越来越多的入口调用code editors的功能,让程序员可以无时无刻地指挥AI干活。

过去:将 AI 塞进开发者的“输入法”

在 Copilot 进入主流视野之前,AI Coding其实已经有了一种古朴的使用方法:chatgpt.com网页上输入自己的问题,通过对话式解决遇到的报错、语法细节、工程配置等问题。这种用法其实是在把AI当作一种新的知识检索与解释引擎,就像过去去搜Stack Overflow/Reddit/CSDN 一样,把问题描述成自然语言,拿到一段“看起来合理”的回答,再据此完成自己的代码编写。

而Copilot的出现,让开发者不必离开当前文件,不必把需求改写成一段长问题,也不必复制粘贴示例代码——只要继续写,AI 就会在你敲击键盘的间隙给出下一段建议。

这种产品形态的核心,是把 AI 从“讲解者”升级成“续写者”。在交互上,它不要求你先提出一个完整问题,而是默认你正在进行某个任务,并用一种极轻量的方式参与其中:幽灵文本(ghost text)+ 一键接受(Tab)/一键拒绝(Esc)。从体验上看,Copilot 更像一个“会读上下文的超级自动补全”,让开发者进入一种连续的“Tab-flow”:写注释、写函数签名、写几行骨架,然后不断用接受/拒绝把它拉到正确轨道上。

怎么做到“像读心”一样补全的?

从原理上看,早期代码补全插件并不需要“理解整个仓库”,它更像一种工程化的 prompt 组装器,省去你拷贝上下文到网页的成本,快速帮你生成目标代码

- 输入源:当前文件、光标附近的代码片段、你刚写的注释/变量名/函数签名,以及少量工程侧信息(语言、依赖、常见框架习惯等)。

- 处理方式:把这些“局部线索”整理成一段 prompt,交给代码模型去做“下一段最可能出现什么”的预测(本质是 next token / next chunk 生成)。

- 输出形态:生成候选代码,以不破坏你编辑节奏的方式呈现(内联 ghost text 或补全面板),由你决定是否采纳。

而整个处理流程会涉及代理服务器和模型的交互,整个流程如下图所示

在最关键的Propmt构建中,Copilot采用了FIM(Fill-in-the-Middle)模式,传统的模型只会“续写”,而 FIM 模式可以提供光标前(Prefix)和光标后(Suffix)的代码,同时也会去收集相似代码片段和打开的其它文件信息,一个典型FIM结构的prompt的结构如下:

JSON |

在 Prompt构建过程中,Copilot 设计了“许愿池”机制(Prompt Wishlist)。它会首先列出一个包含各种可能上下文元素的“愿望清单”,然后根据优先级和剩余的 Token 预算,贪心地从清单中挑选元素,拼装成最终的 Prompt。Copilot 会像集邮一样,搜集所有可用的上下文信息,形成一个初始的 Wishlist,然后根据预设的优先级和插入顺序进行排序这是一个动态的过程,受到大量 A/B 实验开关的控制。例如:

- suffixPercent:大约 15% 的 Token 预算会专门留给 suffix,这体现了对 FIM 模式的重视。

- fimSuffixLengthThreshold: 如果 suffix 太短,可能就不会启用 FIM 模式。

- SuffixStartMode: 决定 suffix 从哪里开始截取,有时会从当前函数的下一个兄弟函数开始,以提供更完整的上下文。

- NeighboringTabsOption: 控制从其他文件中提取代码片段的“激进”程度。

最后,Copilot 会像整理行囊一样,按照排序后的列表,逐一将元素塞进 Prompt,直到 Token 预算耗尽。

怎么就迅速流行了?

Copilot 的破圈不在于它一开始就能写对复杂系统,而在于它让开发者第一次体感到:把“机械输入”外包给模型以后,人开始从键盘打字员变成了代码编辑者与审稿人。 |

除去Github本身的宣发优势,在社区中能得到广泛认可是因为它解决了一个非常朴素的问题:人类在写代码时,大量时间花在“把已知结构打出来”。早期 Copilot 最强的价值点,集中在以下几类“局部效率”:

- 样板代码与惯用法的加速:CRUD、参数校验、错误处理骨架、重复性重构、常见算法套路……这些东西“创造性”很低,但手打很累。

- 从注释/函数签名到第一版实现:你把输入输出、边界条件写清楚,Copilot 往往能给出一个“可运行的雏形”,把你从空白页推进到可迭代状态。

- 在“卡壳点”给一个方向:哪怕它不完全正确,它也能提供一条可修改的路径,让开发者从“想不出来怎么写”变成“我知道该改哪里”。

而Copilot将这几个能力,把“AI”塞进了开发者原本就要按 Tab 的地方,让开发者在原来的工作流里多一个候选:IDE 里出现 ghost text,按 Tab 接受、按 Esc 忽略——几乎零学习成本。它不像一个需要你“切过去说话”的工具,更像升级版 autocomplete,所以更容易形成习惯与依赖。

除次优秀的使用体验外,它的流行还来自于一种被社区反复提到的“学习增益”——它把很多原本需要查文档的片段,变成了一个可编辑的草稿,让学习者用“对照—运行—改错”的方式,更快跨过陌生语法与生态的启动门槛。这个现象在 Stack Overflow 和Copilot的调查中也能看到:正在学习编程的人群,比职业开发者更倾向于使用/计划使用 AI 工具。

github于2023统计的代码经验/AI工具接受度图

在 Stack Overflow 2023 开发者调查中,GitHub Copilot 在 “AI developer tools / AI tools” 相关统计里占有了 55% 的使用比例,显著高于第二名,出现了“超过 100 万开发者激活”的标志性数字。

代码补全的天花板:只会“写”而不能“做”

早期 Copilot 代表的补全工具,本质上是把 AI 用作“编码阶段的局部加速器”:它让代码在输入法意义上更容易生成,却难以替代软件工程真正难的部分——对齐约束、覆盖边界、验证闭环与协作交付。

- 上下文短、视野窄:它看见的往往是局部片段,只能看见当前文件、附近函数、少量相邻代码,以及少数被检索到的参考片段,而系统正确性恰恰来自“全局约束”的一致对齐,导致在越复杂的系统中采纳率越低。

- 不会替你验证闭环:补全插件解决的是“输入”问题,而软件工程的硬骨头是“验证”与“协作闭环”。补全工具通常不具备持续推进任务的能力,它不会自动跑测试,也不会根据失败反复迭代修复,更不会完成协作链路。当项目越来越大、规则越多的时候,一个连code lint都无法运行的工具,当然写不出可靠的代码。

- 缺少工具链整合:成熟项目里,一个需求往往牵涉:多文件改动、文档补充、PR 描述、review 反馈、版本发布。而代码补全只能用于“当前文件、当前函数”的生成,无法把任务拆解为一组跨文件、可验证、可合并的变更集合。

随着AI模型能力越来越强,行业对AI的期待也越来越高,IDE中的局部补全已经没法再被用户当成“AI的魔法”,关注点也从“写得快”转向“交付对”,AI Coding 的下一步也就不可避免地从补全走向对话,让模型不仅续写代码,还要能理解上下文、维护目标、调用工具并推动一次真正可审阅的变更落地。

现在:用AI落地自己的IDEA

2024年6月,Anthropic发布了他们的Claude 3.5 Sonnet 模型,相比于8k上下文的gpt4,提供了200K上下文还有超强的问题解决能力,模型开始可以把“多个关键文件 + 报错信息 + 测试用例 + 接口约定”放进同一次推理里,不必频繁切片,开发者一边感慨着新模型的强大,一边不再满足于让 AI 只当一个“超级补全”,开始围绕着AI Coding 的“现在”提出了一个更宏大的命题展开:如何让 AI Coding从“简单续写”走向“想法落地”?

claude 3.5 sonet benchmark score

AI IDE:从“超级补全”到“可行动的协作者”

AI IDE不颠覆开发者熟悉的编辑器形态,而是将 Agentic Workflow(代理工作流)深度融合在 IDE 的每一个角落,让 AI 从一个“对话框里的助手”变成无处不在的“合作伙伴”。同时由于有了更全的代码仓库信息,在辅助编程上也有了更强的能力。

Codebase Indexing:把整仓库变成可检索的上下文

Cursor 的一个基础设定是:先把代码库做索引/embedding,再让 Agent 基于索引召回相关文件与片段。它在官方特性页里直接把这件事称为“codebase understanding / codebase embedding model”,从而为大型代码库提供快速、精准的语义搜索能力,将上下文拓展至整个仓库而不仅仅是光标前后。

- 本地数据构建:在客户端本地,系统首次会扫描整个工作区,为代码库构建一棵基于内容哈希的 Merkle tree。在后续的周期性检查中,系统只需对比 Merkle tree 的哈希值,就能快速定位发生变更的文件,形成一个增量变更集。

- 服务器存储:变更集上传至服务端后,文件被切分成小的代码片段(chunks),并为每个片段计算 embedding。这些向量最终被写入如 Turbopuffer 等专门的向量数据库中。值得注意的是,服务端持久化的并非代码原文,而是向量本身,以及一组用于定位的元数据,包括混淆处理过的文件引用(path_ref)、代码在文件中的具体行号范围(range)和用于去重的片段哈希(chunk_hash)。这一策略主要用于保证用户数据的隐私性。

使用Merkle tree快速检测代码变更

- 检索优化:当用户发起查询时,查询语句同样会被转换为 query embedding。系统利用此 embedding 在向量库中进行高效的近邻检索,找出最相关的 Top-K 个代码片段“指针”(即 path_ref 和 range)。这些“指针”被返回给客户端,客户端根据它们在本地工作区中精确提取出对应的代码原文。最后,这些代码片段作为上下文被回传给大语言模型,辅助其完成代码生成或问答任务。

而上下文拓展到整个仓库后,相比于Copilot,带来的优势有

- AI 能按“语义相关性”找到真正应该改的文件,而不是只依赖你当前打开的几页代码

- 跨文件改动时,更容易保持一致性(同类逻辑复用、命名风格、错误处理规范)

Multi-file Edits / Apply Workflow:交付“可应用的变更集”

在扩大了AI Coding的能力范围后,一个重要的问题也摆在面前:“用户怎么去响应AI生成的代码?”

AI ide给出的答案是把一次对话的输出固化为可审阅、可分块应用、可回滚的改动集合。它将输出从“生成文本”升级为“可审阅、可局部应用、可回滚”的改动集合,应用在ide中的结果,是更贴合真实开发中的 PR ,将accpet和reject的能力交还给开发者们。

客户端基于 diff 中的“指针/上下文”读取本地文件并执行 patch 应用;在 Agent 模式下,系统还会通过工具循环(读写文件、运行命令、基于报错再迭代)把变更推进到可验证状态。

而针对“改几百行要调用很多次、容易循环卡住、速度慢”的问题,像Cursor 还专门训练过一个用于“全文件快速应用编辑”的模型 Llama-3-70b-ft-spec,相比同期的GPT 4o模型在大量代码修改时,拥有更强的ide编辑能力和响应速度,可以一次完成整个文件的编写,不必靠多轮模型调用拼出来。

Llama-3在推测性编辑时的响应速度

工作流:IDE 内的“一条龙”服务

除了代码编辑场景外,AI IDE还就开发链路尽可能地补全AI接入,让每个环节都可以低成本地使用AI提效。

- Lint 自动 fix:编码错误的“自动收尾”

在真实开发里,很多时间并不是花在核心逻辑上,而是花在“让它能过规则”:unused、import 顺序、格式化、某些类型/风格约束。而现有的AI IDE把这一类问题从“你写完之后再手动清理”变成“变更集落地后的自动收敛步骤”。实现上先获取 lint/formatter 的诊断(来自工具或编辑器问题面板),再把这些诊断转化为可应用的 patch,最后按文件回填并 Apply,直到告警消失或收敛到可接受的状态。

这一点在跨文件改动里尤其重要。Multi-file Apply 往往会带来大量小而分散的改动点:某处新增了导入,另一处出现了未使用变量,第三处触发了风格规则。让 AI 在最后统一“收尾”,利用ide原有的能力提高编码质量和可靠性。

- 集成终端:编辑器能力的延伸

AI IDE把终端变成 Agent 可用的工具之一:让AI的能力从“编辑器内的文本生成”扩展为“对工程工具链的可执行控制”,让 Agent 能直接做“配置落地”的动作,而不是停留在“建议你这样设置”。让开发者不需要频繁离开对话去手动跑命令、贴输出、再回到 IDE 解释一遍。

- git代码流集成

git管理先前就是IDE插件中最“卷”的赛道之一,而AI IDE融入其中后,可以基于你已经 staged 的 diff 来生成 commit message,在commit的时候自动触发review hooks,对变更内容进行review,省去功能概括耗费时间的同时提高代码质量。

这一整能力被Aime/Manus/AIPA广泛实现,在补充了网页预览能力和vercel等部署功能,吸引大量非研发者从0到1完成想法落地,而这一段时间新的AI工具也大量出现,以“端到端”编程为卖点接连上线。

把这三块能力连起来看——Codebase Indexing 解决“找对上下文”,Multi-file Apply 解决“把改动交付成可审阅的变更集”,再叠加 IDE 内的一条龙工作流(lint 自动收尾、终端可执行、git 流与 review/commit 绑定、预览与部署反馈回流)——AI IDE 实际上完成了一次范式迁移:它不再只是在光标附近帮我写几行代码,而是把 AI 变成能推进工程状态的“实习生”。

cursor和trae也因此在商业上取得了巨大的成功,Cursor在2025年年化收入超过10亿美元,并服务 数百万开发者,同时也在去年年底被估值为293亿美元;Trae在上线五个月用户数就达到了100万,相比于copilot快了整整一年。

Claude Code:终端里的“可行动协作者”

如果说 Cursor 是把 AI 无缝嵌入图形化界面的典范,那么 Claude Code 则选择了另一条更“复古”也更极客的道路:让 AI 成为终端(CLI)里的原生公民。它不试图重新发明一个编辑器,而是作为一个强大的命令行工具存在,可以与任何 IDE、任何工作流组合。

它的设计哲学更接近 Unix 世界的“可组合性”:把自己变成一个能接入现有工具链的“行动体”,与 shell、git、测试框架、CI 脚本天然咬合,而不是把开发者锁进某个专用 GUI 的工作方式里。

Claude Code 为什么“能做完事”

如果把 Claude Code 的系统拆开看,它其实非常像一个经典的“本地执行 + 远端推理”的 agent 架构:

- 本地执行层(Claude Code 客户端)

它运行在你的机器上,掌管三件事:

- 工具调用:读文件、改文件、搜索、跑命令、跑测试、做 git 操作;

- 状态与回传:把命令输出、diff、关键文件片段回传给模型;

循环控制:把任务推进到“可交付”的终点,而不是停在“建议”。

远端智能层(Claude 模型:规划与决策的“大脑”)

智能层的架构可以概括为“一个大循环”,由最简单的 大模型-工具 调用循环构成,AI去分析用户输入,如果问题足够简单,主循环只需通过迭代调用工具即可处理;针对复杂任务会调用Task工具,主智能体创建自身的克隆,将问题分解为子问题,同时保证最终的预期结果。

而Claude原生集成了若干工具,包括bash、文件读写、规划模式等等,最重要的Task工具是一个muti agent系统,架构如下:

出自http://anthropic.com/engineering/built-multi-agent-research-system

- LeadResearcher先判断问题复杂度,再把任务拆分成多个子任务,分派给不同 subagents 并行去搜集信息;当信息足够时退出 research loop。

- Subagents(执行者):各自带着更明确的目标、输出格式和工具使用边界去检索与归纳;在每轮工具调用后会做一次反思/校验,决定下一步怎么搜。

- CitationAgent(引用代理):在 research loop 结束后接管,把“研究报告 + 已收集文档”对齐,找出每个关键断言对应的具体引用位置,保证所有结论都能被来源支撑。

而在具体落地的过程中,多智能体相对单智能体协调复杂度也显著增长,早期失败案例包括“为了一个简单问题生成 50 个 subagents”、“subagents 相互干扰、不断更新,反而分散注意力”,最后围绕提示词工程(prompt engineering)进行改进和优化。

- 扩展与平台层

当项目进入真实企业流程,交付往往离不开外部系统(工单、文档、知识库、发布系统、监控等)。Claude Code 强调通过 MCP(Model Context Protocol) 接入外部工具,把“编码”扩展为“端到端交付”,让 Claude Code 不止能改 repo,还能理解“repo 之外”的上下文与流程约束。

未来:让AI真正像“人”一样完成需求

从2022 年 6 月,GitHub Copilot正式 GA,预览期约 120 万人报名试用,到 2025 年 7 月 30 日,Microsoft在财报电话会披露:GitHub Copilot 累计用户达到 2000 万,AI Coding越来越融入了Coding的一部分。

同一时期,GitHub在 2025 年 Octoverse 指出:新加入 GitHub 的开发者中,接近 80% 在第一周内会使用 Copilot,在国内高校里,越多越多计算机专业的同学也习惯了用AI完成老师布置的编码作业和实验室任务。

虽然AI IDE在开发链路有着完整融合,Agent Cli凭着轻巧好用的特性在各个平台得以接入,仍有“三朵乌云”笼罩在AI Coding的上方:

- 上下文与历史逻辑断层:复杂软件交付的核心风险从“写代码”转移到“理解系统”:AI 在跨模块、跨版本演进的代码库中,虽然有了Agents.md等补充说明,但仍难以可靠恢复“写在人的脑子里”的决策背景(历史权衡、隐式约束、组织约定),导致生成结果在局部正确、全局不一致,难以支撑大型项目的持续演进。

- 风格与规范众口难调:AI 输出质量上限受提示词与团队规范治理约束,在此之上开发者对注释密度、命名习惯、错误处理、抽象层级、输出语言、冗余解释等偏好也各不相同,AI 生成结果难以在跨人协作中保持一致的工程美学与可维护性。

- 闭环验证不足:AI Coding 的最后一公里仍是“可执行的验证闭环”:当前的 Browser/Computer Use 虽可自动点击、输入、浏览,但在复杂 UI、动态页面、权限/登录、长任务与异常恢复上仍不稳定;同时多模态理解与执行之间存在误差,使得“像人一样体验产品并验证”仍主要停留在受控环境与基准测试阶段。OpenAI API 文档也把 Computer use 标注为 beta/preview,并提醒不要在高风险、强认证环境中盲目信任。

OpenAI CUA的任务完成率 (https://openai.com/zh-Hans-CN/index/computer-using-agent/?utm\_source=chatgpt.com)

组织级记忆

如果把一个成熟团队的交付能力拆开,代码只是最终沉淀;真正让系统长期可演进的,是隐藏在过程里的“因果链”:为什么采用这个架构、为什么拒绝另一个方案、哪些地方踩过坑、上线后出现过哪些事故、哪些约束是被血泪教训写进来的。而这部分知识通常散落在PR 讨论、Issue、告警、复盘文档、灰度/回滚记录里,甚至只存在于核心成员的口述经验中。

而未来,随着skills的兴起,相信会有更好的记录系统,支持跨系统的“因果链检索”(代码变更 → PR → Issue → 代码草稿 → 事故/告警),从 PR/讨论自动抽取决策要点生成草稿,自动识别“过期决策”(依赖变更、架构迁移)并提醒修订。

AI本地记忆

moltBook的大火,一大原因是它将任务运行在计算机本地。正如插件补全到AI IDE的跨越,AI上下文上限的增长在里面起了很大作用。也许在未来AI能记忆的上下文会进一步增长,而相应地产生一套“编程习惯记忆助手”,将记忆做成可审计、可检索、可更新的外部系统,存储记录开发者日常工具链(文件、Git、CI、监控)的使用习惯。 当正式开始执行任务时,可以去尽可能载入开发者自己的开发习惯,真正地成为一名能辅助、能教育的“助手实习生”。

为AI而生的交互规范

真实产品验证的最大难点不是“点按钮”,而是环境的不确定性:登录与权限差异、页面状态分支、弹窗与异常、网络抖动、数据不一致、第三方依赖波动……人类能凭经验绕过,AI 要做到稳定,需要的是“执行体系”而非“视觉能力”本身。

但真实验收的关键是判定标准。人类 QA 在做的事情,本质上是把需求转化为断言:看到什么、没看到什么、某个指标是否变化、某条日志是否出现、某个请求是否符合契约。

在未来,或许会有一套规范,将软件工程教程范式定义为可机读的断言集合,把 PRD/issue/验收标准自动转成断言(UI 状态、API 响应、日志、指标、数据一致性、权限边界)。

在此之上,人为交互的规范都将抽象化,相信会有越来越多像moltBook这样的社区,针对AI提供一套更方便的交互形式,让AI可以原生地完成所有功能。

最后,随着 AI Agent 形态持续成熟,AI Coding 很可能在未来两年再次改写我们的直觉:它不再只是“更聪明的补全”或“更顺手的对话框”,而是逐步具备一名工程师完成交付所需的完整能力栈。

但对AI Coding 的最佳期待并不是“某一天它完全取代人”,而是它把软件工程中最耗时、最重复、最容易出错的部分系统性外包给机器,让大家把注意力重新集中在真正稀缺的东西上——对问题的洞察、对系统的判断,让“码农”、“搬砖”这两个词彻底成为过去式。

代码会消失,但创造的欲望不会